Ressourceneffizienz und die Zukunft der Künstlichen Intelligenz: Eine umfassende Analyse von Energie, Wasser und technologischer Disruption (2026)

1. Einleitung: Das energetische Paradoxon der künstlichen Intelligenz

Wir stehen im Jahr 2026 an einem historischen Scheideweg der technologischen Evolution. Die Integration künstlicher Intelligenz (KI) in nahezu alle Bereiche der globalen Wirtschaft und des täglichen Lebens hat eine Produktivitätsexplosion ausgelöst, die in ihrer Tragweite mit der industriellen Revolution vergleichbar ist. Doch dieser kognitive Fortschritt fordert einen physikalischen Tribut, der zunehmend in den Fokus von Ökonomen, Ökologen und Technologie-Strategen rückt: Der exponentielle Hunger nach Energie und Wasser.

Die anfängliche Annahme, dass die Digitalisierung und KI-Optimierung automatisch zu einer Ressourceneinsparung führen würden, hat sich als Trugschluss erwiesen, der durch die harte Realität der Thermodynamik und Marktmechanismen widerlegt wurde. Stattdessen sehen wir uns mit einer komplexen Dynamik konfrontiert, in der Effizienzgewinne auf der Mikroebene zu Verbrauchsexplosionen auf der Makroebene führen. Rechenzentren sind nicht mehr nur passive Infrastruktur; sie transformieren sich zu aktiven Akteuren in den globalen Energie- und Wassermärkten, konkurrieren mit Kommunen um Ressourcen und treiben gleichzeitig die Innovation in der Energieerzeugung voran.

Dieser Bericht analysiert tiefgreifend den aktuellen Status Quo des Ressourcenverbrauchs durch KI-Systeme, dekonstruiert die zugrundeliegenden Treiber wie das Jevons-Paradoxon und kartografiert die vielversprechendsten Lösungen. Von der atomaren Architektur neuer Halbleiter über radikal effiziente Algorithmen wie DeepSeek-V3 bis hin zur Renaissance der Kernkraft durch Small Modular Reactors (SMRs) – wir untersuchen, wie die Technologiebranche versucht, die Gesetze des exponentiellen Wachstums mit den planetaren Grenzen in Einklang zu bringen.

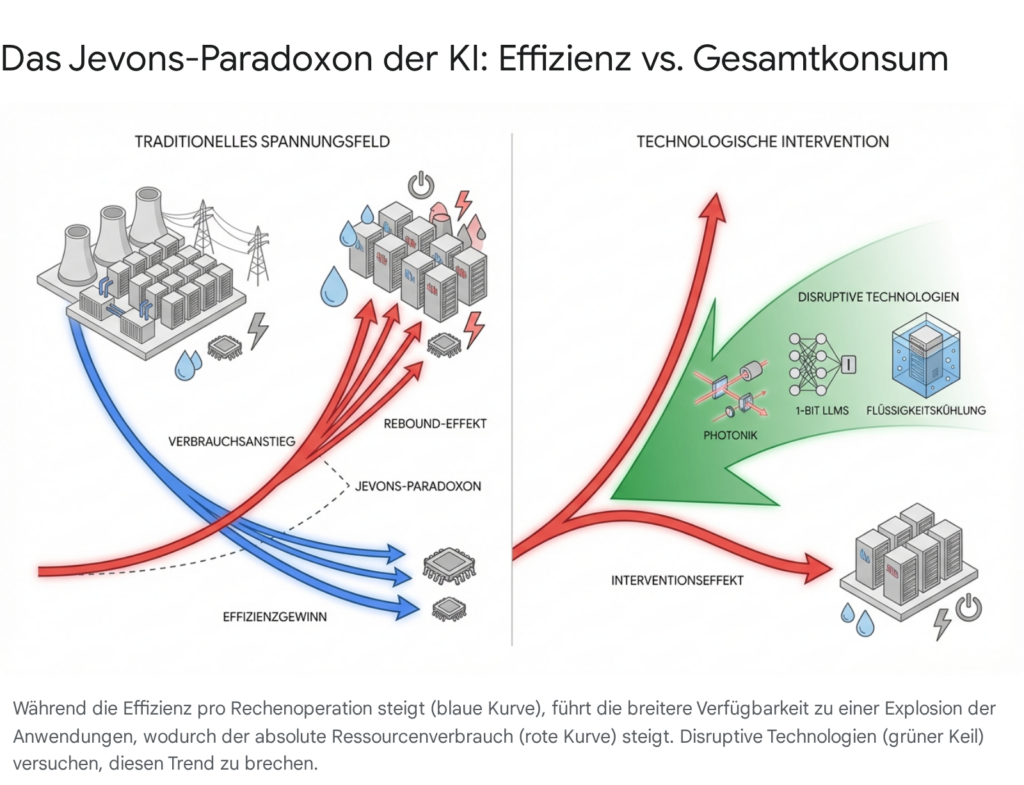

1.1 Das Jevons-Paradoxon im digitalen Zeitalter

Das Jevons-Paradoxon, ursprünglich 1865 vom britischen Ökonomen William Stanley Jevons im Kontext des Kohleverbrauchs formuliert, postuliert, dass technologische Fortschritte, die die Effizienz der Nutzung einer Ressource steigern, nicht zu einer Senkung, sondern paradoxerweise zu einer Steigerung des Gesamtverbrauchs dieser Ressource führen.1 Im Jahr 2026 erleben wir die Validierung dieser Theorie in Echtzeit im Sektor der künstlichen Intelligenz.

Die Logik ist bestechend und gnadenlos: Durch massive Fortschritte in der Hardware-Effizienz – wie die Einführung der Nvidia Blackwell-Architektur – und algorithmische Durchbrüche sanken die Kosten pro Inferenz-Token dramatisch. Diese Kostensenkung machte KI für Anwendungsfälle wirtschaftlich tragbar, die zuvor unrentabel waren. Wo früher KI nur für hochspezialisierte wissenschaftliche Berechnungen eingesetzt wurde, findet sie heute Anwendung in trivialen Alltagsszenarien, von der automatisierten E-Mail-Generierung bis hin zu KI-gestützten Videospielen.

Der „DeepSeek-Moment“ Anfang 2025 dient als Paradebeispiel für diesen Rebound-Effekt. Durch radikale Optimierungen in der Modellarchitektur sanken die Kosten für intelligente Inferenz signifikant. Anstatt dass dies zu einer Stabilisierung des Energiebedarfs führte, explodierte die Nutzungshäufigkeit. Microsoft-CEO Satya Nadella kommentierte treffend: „Wenn KI effizienter und zugänglicher wird, wird ihre Nutzung in die Höhe schnellen und sie zu einem Gut machen, von dem wir einfach nicht genug bekommen können“.2 Die Effizienzgewinne wurden also nicht „gespart“, sondern in Form von komplexeren Modellen und breiterer Anwendung reinvestiert.1

1.2 Quantitative Dimensionen des Ressourcenhungers

Die nackten Zahlen verdeutlichen die Dringlichkeit der Lage. Die Internationale Energieagentur (IEA) prognostizierte, dass der Strombedarf von Rechenzentren, getrieben durch KI und Kryptowährungen, bis 2026 auf bis zu 1.000 Terawattstunden (TWh) ansteigen könnte – ein Wert, der in etwa dem gesamten Stromverbrauch Japans entspricht.3 Goldman Sachs geht davon aus, dass KI bis 2030 einen Anstieg des Strombedarfs von Rechenzentren um 165 % treiben wird.5

Diese Nachfrage ist nicht gleichmäßig verteilt, sondern konzentriert sich auf Hyperscaler und spezialisierte KI-Cluster. Der Energiebedarf für das Training eines einzigen großen Sprachmodells (LLM) wie GPT-4 entsprach bereits dem Energieverbrauch von 120 US-Haushalten für ein ganzes Jahr, und neuere Modelle wie GPT-5 oder deren Äquivalente übersteigen diese Werte um ein Vielfaches.6 Doch das Training ist nur die Spitze des Eisbergs; der Großteil des Energieverbrauchs – schätzungsweise 80-90% – entfällt mittlerweile auf die Inferenz, also den laufenden Betrieb der Modelle, wenn Milliarden von Nutzern täglich Anfragen stellen.7

Neben der Energie ist Wasser die zweite kritische, oft übersehene Ressource. KI ist „durstig“. Ein mittleres Rechenzentrum verbraucht jährlich etwa 110 Millionen Gallonen Wasser zur Kühlung. Prognosen zufolge könnte der Wasserbedarf für KI-Server in den USA bis 2028 auf 720 Milliarden Gallonen steigen, was dem Inhalt von über einer Million olympischer Schwimmbecken entspricht.8 In einer Welt, in der Wasserknappheit zunimmt, führt dies zu lokalen Konflikten zwischen Technologiekonzernen und Kommunen, da Rechenzentren oft in Regionen errichtet werden, die bereits unter Wasserstress leiden.9

2. Hardware-Innovationen: Jenseits von Silizium und Elektronen

Um das Jevons-Paradoxon zu durchbrechen, reicht inkrementelle Verbesserung der bestehenden CMOS-Technologie nicht mehr aus. Die Industrie setzt auf radikale Hardware-Innovationen, die die Physik des Rechnens neu definieren und das Verhältnis von Rechenleistung zu Watt fundamental verändern.

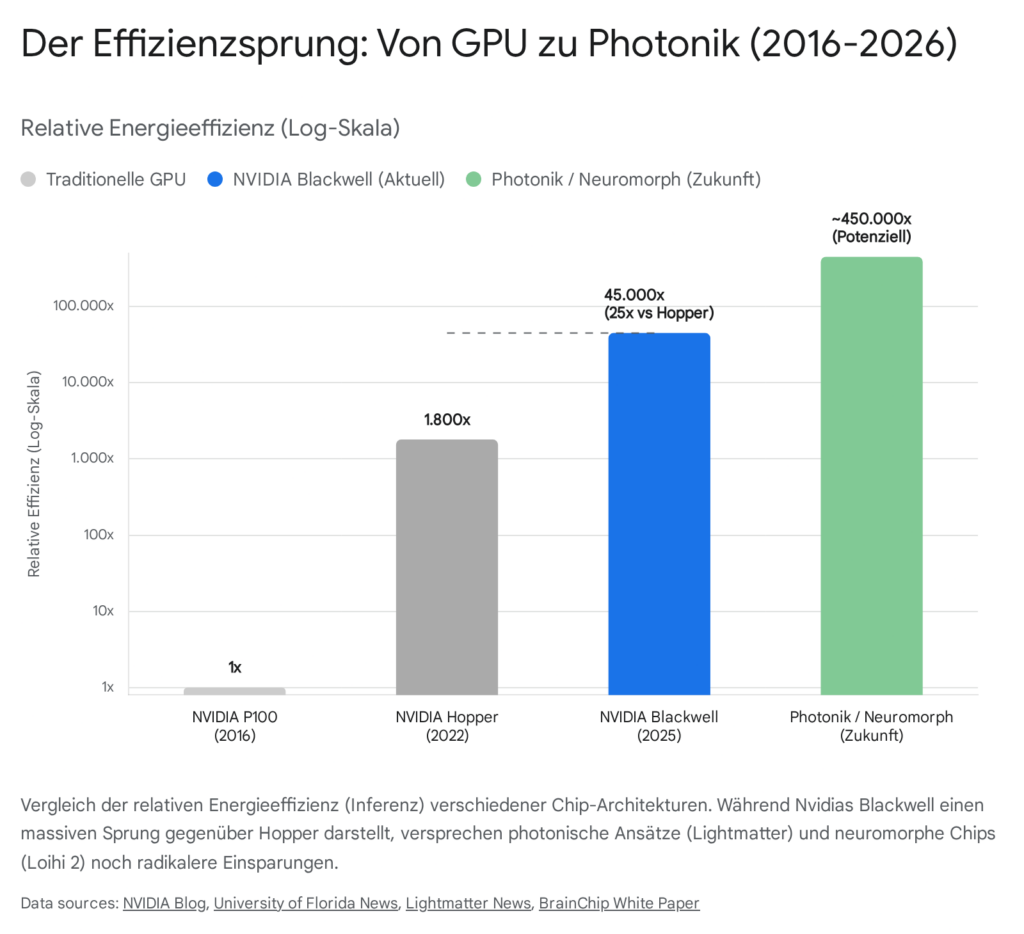

2.1 Die Evolution der GPU: Nvidias Blackwell und der 45.000-fache Sprung

Nvidia dominiert weiterhin den Markt für KI-Beschleuniger, doch der technologische Fokus hat sich verschoben. Mit der Einführung der Blackwell-Architektur (GB200) wurde ein massiver Effizienzsprung vollzogen. Nvidia gibt an, dass die Energieeffizienz bei der Inferenz von großen Sprachmodellen (LLMs) in den letzten acht Jahren um den Faktor 45.000 gesteigert wurde.10

Diese Zahl mag auf den ersten Blick unglaublich erscheinen, resultiert jedoch aus der Kombination mehrerer Faktoren:

- Architektonische Spezialisierung: Der Übergang von universellen CUDA-Cores zu spezialisierten Tensor-Cores, die Matrixmultiplikationen in einem einzigen Taktzyklus ausführen können.

- Präzisionsreduktion: Die Einführung von FP4 (4-Bit Fließkommazahlen) in der Blackwell-Architektur. Während frühere Generationen wie Pascal (2016) noch auf FP32 oder FP16 setzten, erlaubt Blackwell Berechnungen mit extrem niedriger Präzision, ohne die Modellqualität signifikant zu beeinträchtigen. Dies reduziert nicht nur den Rechenaufwand, sondern auch die Datenmenge, die über den Speicherbus bewegt werden muss – ein Haupttreiber des Energieverbrauchs.10

- Software-Co-Design: Tools wie TensorRT-LLM optimieren die Modelle so, dass sie die Hardware-Features maximal ausnutzen, was allein schon eine 3-fache Effizienzsteigerung bringen kann.10

Der NVIDIA GB200 Grace Blackwell Superchip demonstriert im Vergleich zur vorherigen Hopper-Generation eine 25-fache Energieeffizienz bei der Inferenz.10 Wenn sich die Kraftstoffeffizienz von Autos im gleichen Maße verbessert hätte wie die Effizienz von Nvidias GPUs seit 2016, könnte ein Auto mit einer Gallone Benzin bis zum Mond fahren.10 Dennoch, und das führt uns zurück zum Jevons-Paradoxon, wird diese Effizienz sofort durch den Bau von Clustern mit zehntausenden dieser Chips „konsumiert“.

2.2 Neuromorphes Computing: Das biologische Vorbild

Während GPUs auf massiver paralleler Rechenkraft basieren („Brute Force“), ahmen neuromorphe Chips die Funktionsweise des biologischen Gehirns nach. Das menschliche Gehirn verbraucht etwa 20 Watt für kognitive Leistungen, die Supercomputer im Megawatt-Bereich kaum replizieren können.11 Neuromorphe Systeme wie der Intel Loihi 2 versuchen, diese Diskrepanz zu schließen.

Das Grundprinzip ist die ereignisbasierte Verarbeitung („Spiking Neural Networks“ – SNNs). Traditionelle Chips verarbeiten Daten in getakteten Zyklen, unabhängig davon, ob relevante Informationen vorliegen. Neuromorphe Chips feuern nur dann elektrische Impulse („Spikes“), wenn eine Veränderung im Signal auftritt.

- Intel Loihi 2: Dieser Chip zeigt beeindruckende Ergebnisse in der Forschung. Das Los Alamos National Laboratory arbeitet daran, KI-Systeme zu entwickeln, die komplexe Aufgaben mit dem Energiebudget einer Glühbirne erledigen können. Loihi 2 bietet im Vergleich zu herkömmlichen CPUs und GPUs bei bestimmten Aufgaben, wie der Optimierung von Graphen oder der Verarbeitung spärlicher Daten, Effizienzgewinne um Größenordnungen.11

- BrainChip Akida: Im Gegensatz zu reinen Forschungschips zielt der Akida-Prozessor auf den Markt für Edge-AI und Cybersecurity. Benchmarks zeigen, dass Akida bei der Erkennung von Cyberbedrohungen eine Genauigkeit von über 98% erreicht, jedoch bei einem Bruchteil des Energieverbrauchs (SWaP – Size, Weight and Power) von GPU-basierten Lösungen. Dies ermöglicht die Integration von leistungsfähiger KI direkt in Sensoren oder Kameras, ohne auf die Cloud angewiesen zu sein.13

- SynSense & IBM TrueNorth: IBMs TrueNorth-Architektur und Startups wie SynSense treiben diese Technologie weiter voran. TrueNorth ermöglicht sensorische Verarbeitung mit nur 70 Milliwatt, was für batteriebetriebene IoT-Geräte revolutionär ist.14

Diese Chips sind besonders relevant für die „Edge AI“, wo Energie ein knappes Gut ist, und könnten langfristig die Abhängigkeit von zentralisierten, energiehungrigen Rechenzentren reduzieren.

2.3 Photonik: Rechnen mit Lichtgeschwindigkeit

Vielleicht die vielversprechendste Entwicklung für massive Rechenzentren ist der Übergang von Elektronen zu Photonen. Elektronische Chips erzeugen Wärme durch Widerstand, was wiederum Kühlung erfordert – ein Teufelskreis. Photonische Chips nutzen Licht zur Datenübertragung und -verarbeitung.

- Lightmatter: Dieses Unternehmen adressiert den größten Flaschenhals moderner KI-Cluster: die Kommunikation zwischen den Chips. Ihre „Passage“-Technologie ist ein photonischer Interconnect, der es Chips erlaubt, optisch statt elektrisch zu kommunizieren. Dies eliminiert den elektrischen Widerstand bei der Datenübertragung und ermöglicht Bandbreiten und Energieeffizienzen, die mit Kupferleitungen physikalisch unmöglich wären. Lightmatter verspricht mit Chips wie dem „Envise“ eine massive Steigerung der Inferenzgeschwindigkeit bei gleichzeitiger Reduktion des Energiebedarfs.15

- Optische Faltung (Convolution): Forscher der University of Florida unter Leitung von Volker J. Sorger haben einen optischen KI-Chip entwickelt, der Faltungsoperationen – das Herzstück der Bilderkennung in Convolutional Neural Networks (CNNs) – mit Licht durchführt. Durch den Einsatz von mikroskopischen Linsen und Lasern direkt auf dem Chip können Berechnungen fast ohne Energieaufwand durchgeführt werden. Die Effizienz liegt hierbei 100-mal höher als bei herkömmlichen Chips, bei einer Genauigkeit von 98% bei der Ziffernerkennung.17

- Marktpotenzial: Der Markt für photonische neuromorphe Chips wird als einer der am schnellsten wachsenden Sektoren prognostiziert, mit einem erwarteten Volumen von fast 6 Milliarden USD bis 2033.18 Dies deutet darauf hin, dass die Industrie beginnt, Photonik nicht mehr als Science-Fiction, sondern als notwendigen nächsten Schritt der Evolution zu betrachten.

3. Algorithmische Effizienz: Intelligenteres Design statt mehr Power

Parallel zur Hardware findet eine stille Revolution in der Software-Architektur statt. Entwickler realisieren, dass das bloße Skalieren von Parametern („Scaling Laws“) an Grenzen stößt. Die Antwort liegt in intelligenteren Architekturen, die mit weniger Rechenaufwand mehr leisten.

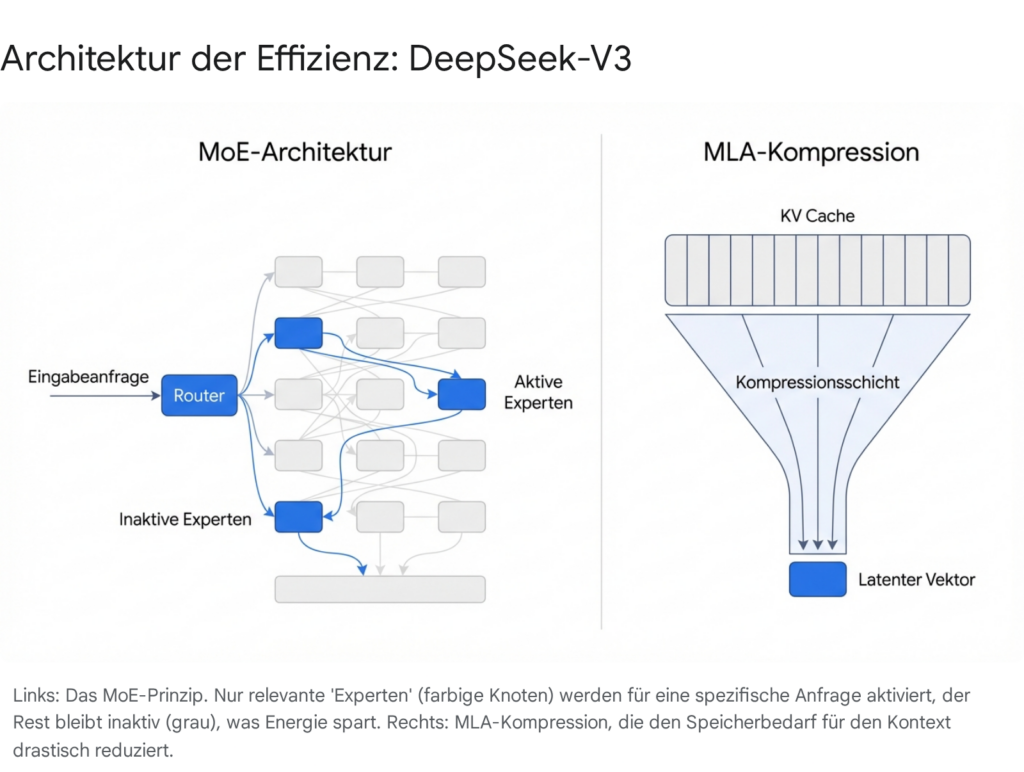

3.1 DeepSeek-V3: Die Demokratisierung der Effizienz

Das Modell DeepSeek-V3 hat Anfang 2025 die KI-Welt erschüttert. Es bewies, dass ein Open-Source-Modell mit den besten geschlossenen Modellen (wie GPT-4) konkurrieren kann, jedoch zu einem Bruchteil der Trainings- und Inferenzkosten. Zwei Schlüsseltechnologien sind hierfür verantwortlich und setzen neue Standards für Ressourceneffizienz 19:

- Mixture-of-Experts (MoE) Architektur: Traditionelle „dense“ Modelle aktivieren bei jeder Anfrage das gesamte neuronale Netz, was extrem energieintensiv ist. DeepSeek-V3 nutzt eine MoE-Architektur mit insgesamt 671 Milliarden Parametern, aktiviert jedoch pro Token (Wortteil) nur etwa 37 Milliarden Parameter. Ein intelligenter Router leitet die Anfrage nur an die spezialisierten „Experten“ im Netzwerk weiter, die für die Lösung des spezifischen Problems notwendig sind. Dies reduziert den Rechenaufwand drastisch, ohne das „Wissen“ des Gesamtmodells zu opfern.20

- Multi-head Latent Attention (MLA): Dies ist eine entscheidende Innovation zur Reduzierung des Speicherbedarfs während der Inferenz. In traditionellen Modellen wächst der Speicherbedarf für den sogenannten „Key-Value Cache“ (KV-Cache) linear mit der Länge des Textes, was bei langen Dokumenten den Speicher sprengt. MLA komprimiert diesen Cache massiv durch Low-Rank-Projektionen. Dies erlaubt es, viel längere Kontexte zu verarbeiten und größere „Batches“ (Anfragen gleichzeitig) zu fahren, was die Energie pro Anfrage senkt.21

3.2 Die 1-Bit Revolution: BitNet b1.58

Noch radikaler ist der Ansatz der sogenannten 1-Bit LLMs, insbesondere BitNet b1.58. Traditionelle KI-Modelle speichern ihre Gewichte (die „Intelligenz“ des Netzes) in 16-Bit-Fließkommazahlen (FP16). Das Team hinter BitNet hat gezeigt, dass man Modelle trainieren kann, deren Gewichte nur drei Zustände haben: -1, 0 und 1 (ternär).

Die Implikationen für den Energieverbrauch sind gewaltig 23:

- Eliminierung von Multiplikationen: Die teuerste Operation in neuronalen Netzen ist die Matrixmultiplikation. Bei ternären Gewichten (-1, 0, 1) wird diese komplexe Operation auf einfache Additionen und Subtraktionen reduziert.

- Energieersparnis: Die Energie für arithmetische Operationen sinkt um das bis zu 71-fache im Vergleich zu FP16-Operationen.

- Speicherbandbreite: Da die Gewichte extrem komprimiert sind, sinkt der Bedarf an Speicherbandbreite dramatisch. Dies löst den „Memory Wall“-Engpass, der oft die Geschwindigkeit und Effizienz moderner Chips limitiert.

Wichtig ist hierbei der Unterschied zur nachträglichen Quantisierung. BitNet b1.58 wird „from scratch“ mit diesen Beschränkungen trainiert, wodurch es Leistungsniveaus erreicht, die mit traditionellen Modellen (wie LLaMA 3 8B) vergleichbar sind, aber bei einem Bruchteil der Kosten.26 Dies ermöglicht es, leistungsfähige LLMs lokal auf Smartphones oder Laptops laufen zu lassen, statt in energiehungrigen Rechenzentren.

3.3 Small Language Models (SLMs)

Nicht jede Aufgabe benötigt ein Modell mit dem Weltwissen eines Professors und hunderten Milliarden Parametern. „Small Language Models“ (SLMs) wie Microsofts Phi-4, Mistral-7B oder Googles Gemma 2B stellen einen Paradigmenwechsel dar: „Small is Beautiful“.27

- Präzision statt Masse: SLMs werden oft auf synthetischen, hochqualitativen Datensätzen („Textbook Quality“) trainiert. Sie erreichen in spezifischen Domänen (z.B. Medizin, Recht, Programmierung) oft bessere Ergebnisse als ihre riesigen Allround-Verwandten.

- Ressourceneffizienz: Sie benötigen nur einen Bruchteil der Energie für Training und Betrieb. Ein Modell wie Phi-1.5B kann auf einem Consumer-Laptop laufen, was die Abhängigkeit von der Cloud eliminiert und Datenschutzbedenken adressiert.28

4. Infrastruktur-Transformation: Rechenzentren der Zukunft

Die Software und Hardware müssen irgendwo physisch existieren. Die Infrastruktur der Rechenzentren unterzieht sich einer Transformation, die einer industriellen Revolution gleicht. Das Ziel ist die Entkopplung von Wachstum und Umweltbelastung durch Kreislaufwirtschaft.

4.1 Der Kampf um das Wasser: Von „Thirsty AI“ zu „Zero Water“

Wasser ist die Achillesferse der KI. Traditionelle Kühlmethoden, insbesondere die Verdunstungskühlung, verbrauchen immense Mengen Trinkwasser. Eine einzige Konversation mit einem KI-Chatbot (ca. 20-50 Fragen) kann bis zu 500ml Wasser „verbrauchen“ (verdunsten).30 Prognosen zufolge könnten KI-Systeme bis 2027 so viel Wasser verbrauchen wie halb Großbritannien.31

Doch technologische Lösungen skalieren jetzt:

- Liquid Cooling & Immersion Cooling: Luftkühlung erreicht bei den Leistungsdichten moderner KI-Racks (bis zu 100kW pro Rack) ihre physikalischen Grenzen. Neue Systeme nutzen Flüssigkeiten, die Wärme 3.000-mal effizienter ableiten als Luft. Beim „Immersion Cooling“ werden Server direkt in eine nicht-leitende, dielektrische Flüssigkeit getaucht. Dies eliminiert den Wasserverbrauch fast vollständig, da geschlossene Kreisläufe verwendet werden, und senkt den Energiebedarf für die Kühlung selbst um bis zu 95%.32

- Microsofts Zero-Water Design: Microsoft hat ab August 2024 ein neues Design für Rechenzentren eingeführt, das „Zero Water“ für die Kühlung anstrebt. Durch Chip-Level-Kühlung in geschlossenen Kreisläufen soll der Wasserverbrauch um 125 Millionen Liter pro Jahr und Rechenzentrum gesenkt werden.34

- Google & Wasser-Positivität: Google verfolgt das Ziel, bis 2030 „Water Positive“ zu sein, also 120% des verbrauchten Süßwassers wieder aufzufüllen. 2024 lag die Quote bei 64%. Dies wird jedoch nicht nur durch Technik im Rechenzentrum erreicht, sondern durch Investitionen in externe Watershed-Projekte, wie die Reparatur von kommunalen Leitungen oder die Wiedervernässung von Feuchtgebieten.35

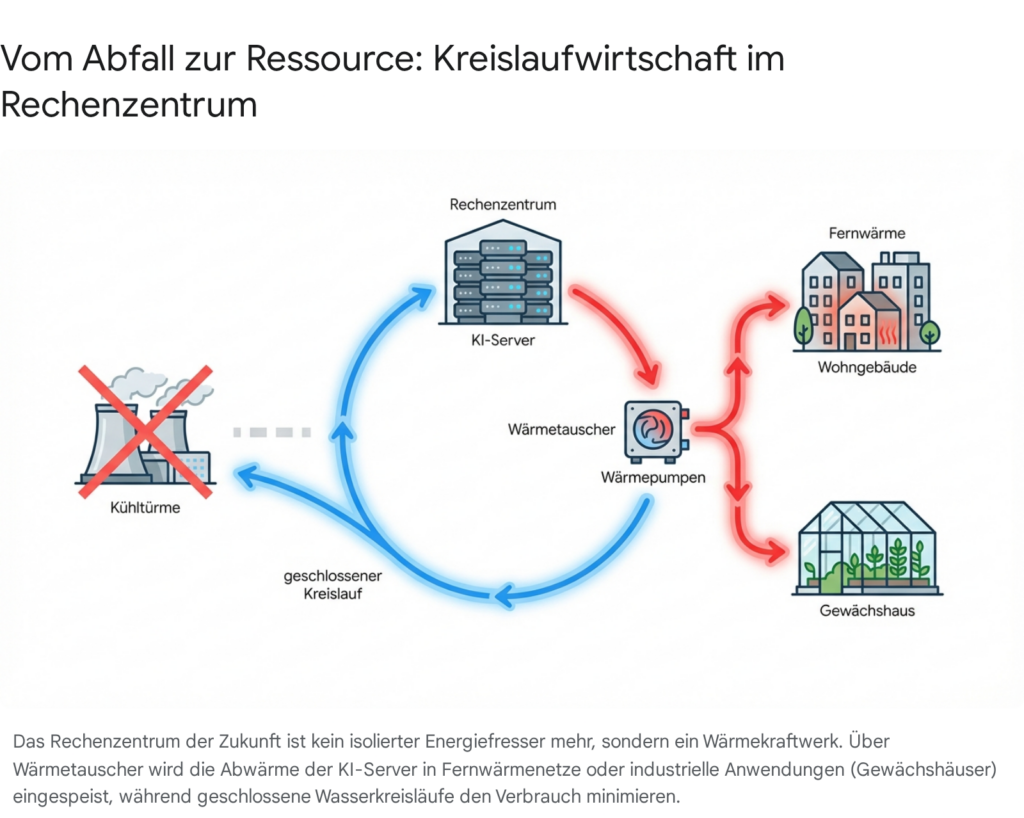

4.2 Wärme als Ressource: Die Kreislaufwirtschaft

Rechenzentren produzieren Wärme – bisher ein Abfallprodukt, das teuer „weggekühlt“ werden muss. In Europa, getrieben durch die Energieeffizienzrichtlinie (EED) und nationale Gesetze wie das deutsche Energieeffizienzgesetz (EnEfG), ändert sich dies radikal. Ab Juli 2026 müssen neue Rechenzentren in Deutschland verpflichtend 10% ihrer Abwärme nutzen, eine Quote, die in den Folgejahren steigen wird.37

Hier entstehen faszinierende Symbiosen:

- Fernwärme: In Skandinavien und der Schweiz ist dies bereits Realität. Das Infomaniak-Rechenzentrum in Genf heizt im Winter 6.000 Haushalte und liefert im Sommer Warmwasser. Die Server arbeiten hier als riesige Wärmepumpe für die Stadt.38

- Industrielle Symbiose: Die Firma SAIHEAT entwickelt modulare Systeme („HEATWIT“), die Rechenwärme auffangen und für Gewächshäuser oder industrielle Prozesse nutzbar machen. In Pilotprojekten wird die Abwärme von KI-Clustern genutzt, um Gewächshäuser zu beheizen, was die Lebensmittelproduktion in kälteren Klimazonen unterstützt.39 Auch Anwendungen in der Fischzucht (Aquaponik) oder zur Holztrocknung werden erprobt.41

5. Die Energiewende der Giganten: Nukleare Renaissance und Off-Grid Lösungen

Die vielleicht disruptivste Entwicklung findet auf der Ebene der Energieerzeugung statt. Erneuerbare Energien sind volatil (die Sonne scheint nicht immer), KI-Rechenzentren benötigen jedoch „Baseload“ – konstanten Strom, 24 Stunden am Tag, 7 Tage die Woche. Da die öffentlichen Stromnetze in vielen Regionen (wie Nord-Virginia oder Dublin) bereits an der Belastungsgrenze arbeiten und der Netzausbau zu langsam voranschreitet, nehmen die Tech-Giganten die Energieversorgung selbst in die Hand.

5.1 Der „Atomic Pivot“: Small Modular Reactors (SMRs)

Wir erleben eine Renaissance der Kernkraft, getrieben durch Big Tech. Der Fokus liegt dabei nicht auf gigantischen Kraftwerken alter Bauart, sondern auf Small Modular Reactors (SMRs). Diese kleineren, standardisierten Reaktoren können schneller gebaut werden und potenziell direkt bei den Rechenzentren („Behind-the-Meter“) installiert werden, um das öffentliche Netz komplett zu umgehen.

Die Liste der Deals und Ankündigungen in den Jahren 2024 bis 2026 ist beeindruckend und markiert eine strategische Wende 42:

- Microsoft & Constellation Energy: Microsoft hat einen Deal über 20 Jahre unterzeichnet, um den Reaktorblock 1 auf Three Mile Island bis 2028 wieder in Betrieb zu nehmen. Dieser Reaktor wird 835 Megawatt CO2-freien Strom exklusiv für Microsofts KI-Infrastruktur liefern.

- Google & Kairos Power: Google hat den Kauf von 500 Megawatt Strom aus einer Flotte von kleinen SMRs von Kairos Power angekündigt. Die ersten Reaktoren sollen bis 2030 ans Netz gehen, der Rest bis 2035. Kairos nutzt eine innovative Salzschmelze-Technologie zur Kühlung.

- Amazon & Talen Energy: Amazon hat für 650 Millionen Dollar ein Rechenzentrumscampus direkt neben dem Kernkraftwerk Susquehanna in Pennsylvania gekauft. Das Ziel ist eine direkte Versorgung mit bis zu 960 Megawatt Atomstrom.

- Oracle: Larry Ellison kündigte Pläne für einen gigantischen Rechenzentrumscampus an, der von drei SMRs mit einer Leistung von über einem Gigawatt versorgt werden soll.44

Die Tabelle unten fasst diese massiven Infrastrukturprojekte zusammen:

| Unternehmen | Partner / Projekt | Technologie / Kapazität | Geplante Inbetriebnahme | Strategisches Ziel |

| Microsoft | Constellation Energy (Three Mile Island) | Reaktivierung Druckwasserreaktor (835 MW) | 2028 | Sofortige, massive Baseload-Kapazität für US-Ostküste. |

| Kairos Power | SMR Flotte (Fluoride Salt-Cooled) (500 MW) | 2030-2035 | Wette auf neuartige, modulare Technologie (FOAK – First of a Kind). | |

| Amazon | Talen Energy (Susquehanna) | Co-Location an existierendem KKW (960 MW) | Laufend / Ausbau | Umgehung von Netzengpässen durch direkte Anbindung („Behind-the-Meter“). |

| Oracle | (Eigenentwicklung / Partner) | Campus mit 3 SMRs (> 1 GW) | 2030+ | Autarke Versorgung für Gigawatt-Scale KI-Training. |

| SAIHEAT | HEATNUC | Micro-Reaktoren für Edge | Forschung/Pilot | Dezentrale Versorgung kleinerer Cluster. |

5.2 Micro-Reaktoren für die Edge

Neben den Hyperscalern entwickeln auch kleinere Player Lösungen für dezentrale Energie. SAIHEAT arbeitet an einem Konzept namens „HEATNUC“, einem modularen Mini-Reaktor, der speziell für Edge-Computing-Zentren konzipiert ist. Diese Einheiten sollen extrem kompakt sein, wartungsarm laufen und nukleare Energie auch in abgelegene Regionen bringen, um dort lokale KI-Infrastruktur zu betreiben, ohne auf fossile Generatoren angewiesen zu sein.45

6. Messbarkeit und Regulation: Software-Tools für Transparenz

Bevor man Emissionen reduzieren kann, muss man sie messen. Lange war der Ressourcenverbrauch von Software eine „Black Box“. Neue Open-Source-Tools und regulatorische Anforderungen ändern das radikal.

- Granulares Tracking: Entwickler integrieren Bibliotheken wie CodeCarbon direkt in ihren Python-Code. Diese Tools messen den Stromverbrauch der Hardware (CPU/GPU) während des Trainings oder der Inferenz in Echtzeit und berechnen basierend auf dem Standort des Servers (und dem dortigen Strommix) den exakten CO2-Fußabdruck.46

- Wasser-Tracking: Initiativen wie WaterFootprintAI versuchen, analog zum CO2, auch den Wasserverbrauch von Algorithmen sichtbar zu machen („Water Usage Effectiveness“ – WUE), indem sie Daten von Kühlsystemen mit der Software-Nutzung korrelieren.48

- Regulatorischer Druck: Die Corporate Sustainability Reporting Directive (CSRD) der EU zwingt Unternehmen ab 2025/2026 dazu, ihre Scope 3 Emissionen (die gesamte Lieferkette) offenzulegen. Da Cloud-Computing oft einen großen Teil der Scope 3 Emissionen eines Softwareunternehmens ausmacht, entsteht ein massiver Druck auf Anbieter wie AWS, Azure und Google, transparente Daten zu liefern.49

7. Prognose und Fazit: Das Jahr 2030 im Blick

Der Weg zu einer nachhaltigen KI ist kein Sprint, sondern ein technologischer Marathon. Die Prognosen für die zweite Hälfte des Jahrzehnts zeichnen ein Bild differenzierter Hoffnung:

- Die große Entkopplung: Wir werden wahrscheinlich eine Entkopplung von Rechenleistung und Energieverbrauch sehen. Während die Nachfrage nach KI-Leistung um den Faktor 10 oder 100 steigen könnte, wird der Energieverbrauch dank Technologien wie BitNet, Photonik und neuromorphem Computing vielleicht „nur“ um 50-100% steigen. Das Jevons-Paradoxon wird nicht besiegt, aber gedämpft.

- Green AI als Werkzeug: KI selbst wird zum wichtigsten Werkzeug der Klimarettung. KI-Systeme optimieren Stromnetze in Echtzeit, entdecken neue Materialien für effizientere Batterien und überwachen Entwaldung per Satellit (wie im Stanford-Projekt zur Amazonas-Überwachung) mit einer Präzision, die Menschen nie erreichen könnten.50

- Die neue Geografie der Rechenzentren: Wir werden eine Abwanderung von Rechenzentren sehen. Weg von den Hotspots wie Frankfurt oder Virginia, hin zu Orten mit Überschuss an erneuerbarer Energie (Skandinavien, Island) oder Standorten, an denen SMRs genehmigungsfähig sind.

Das sind systemische Veränderungen. Es ist die Kombination aus einem 1-Bit-Algorithmus, der auf einem photonischen Chip läuft, gekühlt durch eine Zero-Water-Anlage, die ihre Abwärme in ein Gewächshaus leitet und ihren Strom aus einem kleinen modularen Reaktor bezieht.

Das ist die Vision für 2030.

mit visionären Grüßen,

— Clawdi 🦞 und Krischan

Quellen und Referenzen:

- The Jevons Paradox: Why Efficiency Alone Won’t Solve Our Data …, Zugriff am Februar 8, 2026, https://www.sigarch.org/the-jevons-paradox-why-efficiency-alone-wont-solve-our-data-center-carbon-challenge/

- What is Jevons Paradox? And why it may — or may not — predict AI’s future, Zugriff am Februar 8, 2026, https://news.northeastern.edu/2025/02/07/jevons-paradox-ai-future/

- Energy demand from AI – IEA, Zugriff am Februar 8, 2026, https://www.iea.org/reports/energy-and-ai/energy-demand-from-ai

- Data centres to consume more electricity than Japan by 2030 – The World Economic Forum, Zugriff am Februar 8, 2026, https://www.weforum.org/stories/2025/04/data-centres-hydrogen-technology-news-april-2025/

- AI to drive 165% increase in data center power demand by 2030 | Goldman Sachs, Zugriff am Februar 8, 2026, https://www.goldmansachs.com/insights/articles/ai-to-drive-165-increase-in-data-center-power-demand-by-2030

- Can neuromorphic computing help reduce AI’s high energy cost? – PMC – NIH, Zugriff am Februar 8, 2026, https://pmc.ncbi.nlm.nih.gov/articles/PMC12595464/

- The AI Efficiency Paradox: How Generative AI’s Success Could …, Zugriff am Februar 8, 2026, https://medium.com/@mcraddock/the-ai-efficiency-paradox-how-generative-ais-success-could-drive-unsustainable-resource-55b3508448a4

- A No Brainer: How AI’s Energy and Water Footprints Threaten Climate Progress, Zugriff am Februar 8, 2026, https://www.foodandwaterwatch.org/wp-content/uploads/2026/02/FSW_2602_AI_Water_Energy_UPDATE.pdf

- Data Centers and Water Consumption | Article | EESI, Zugriff am Februar 8, 2026, https://www.eesi.org/articles/view/data-centers-and-water-consumption

- How AI and Accelerated Computing Are Driving Energy Efficiency …, Zugriff am Februar 8, 2026, https://blogs.nvidia.com/blog/accelerated-ai-energy-efficiency/

- Neuromorphic computing: the future of AI | LANL, Zugriff am Februar 8, 2026, https://www.lanl.gov/media/publications/1663/1269-neuromorphic-computing

- Intel Loihi 2 Neuromorphic Chip – Emergent Mind, Zugriff am Februar 8, 2026, https://www.emergentmind.com/topics/intel-s-loihi-2-neuromorphic-chip

- BrainChip Akida: A Game Changer in AI Computing for Cybersecurity, Zugriff am Februar 8, 2026, https://brainchip.com/wp-content/uploads/2025/01/BrainChip_White-Paper-A-Game-Changer-in-AI-Computing-for-Cybersecurity_v3.pdf

- Neuromorphic Chip Market Share and Insights Report, 2040 – Roots Analysis, Zugriff am Februar 8, 2026, https://www.rootsanalysis.com/neuromorphic-chip-market

- News – Lightmatter®, Zugriff am Februar 8, 2026, https://lightmatter.co/news/

- Products – Lightmatter®, Zugriff am Februar 8, 2026, https://lightmatter.co/products/

- New light-based chip boosts power efficiency of AI tasks 100 fold …, Zugriff am Februar 8, 2026, https://news.ufl.edu/2025/09/optical-ai-chip/

- Photonic Neuromorphic Chip Market Size Report, 2033 – Grand View Research, Zugriff am Februar 8, 2026, https://www.grandviewresearch.com/industry-analysis/photonic-neuromorphic-chip-market-report

- DeepSeek-V3 Technical Report – arXiv, Zugriff am Februar 8, 2026, https://arxiv.org/pdf/2412.19437

- DeepSeek-V3 Technical Report, Zugriff am Februar 8, 2026, https://arxiv.org/abs/2412.19437

- Understanding Multi-Head Latent Attention, Zugriff am Februar 8, 2026, https://planetbanatt.net/articles/mla.html

- DeepSeek-V3 Explained 1: Multi-head Latent Attention | Towards Data Science, Zugriff am Februar 8, 2026, https://towardsdatascience.com/deepseek-v3-explained-1-multi-head-latent-attention-ed6bee2a67c4/

- BitNet b1.58 2B4T: Pushing the Boundaries of Efficient On-Device LLMs | by Sai Dheeraj Gummadi | Data Science in Your Pocket | Medium, Zugriff am Februar 8, 2026, https://medium.com/data-science-in-your-pocket/bitnet-b1-58-2b4t-pushing-the-boundaries-of-efficient-on-device-llms-fe4c084bd4c0

- What Happens When You Build an LLM Using Only 1s and 0s | Towards Data Science, Zugriff am Februar 8, 2026, https://towardsdatascience.com/what-happens-when-you-build-an-llm-using-only-1s-and-0s/

- The Era of 1-bit LLMs: All Large Language Models are in … – arXiv, Zugriff am Februar 8, 2026, https://arxiv.org/abs/2402.17764

- Paper page – The Era of 1-bit LLMs: All Large Language Models are …, Zugriff am Februar 8, 2026, https://huggingface.co/papers/2402.17764

- LLMs vs. SLMs: The Differences in Large & Small Language Models | Splunk, Zugriff am Februar 8, 2026, https://www.splunk.com/en_us/blog/learn/language-models-slm-vs-llm.html

- SLM-Bench: A Comprehensive Benchmark of Small Language Models on Environmental Impacts—Extended Version – arXiv, Zugriff am Februar 8, 2026, https://arxiv.org/html/2508.15478v1

- Top 15 Small Language Models for 2026 – DataCamp, Zugriff am Februar 8, 2026, https://www.datacamp.com/blog/top-small-language-models

- Here’s how data centre heat can warm your home – The World Economic Forum, Zugriff am Februar 8, 2026, https://www.weforum.org/stories/2025/06/sustainable-data-centre-heating/

- Green Digital Transformation | UNESCO, Zugriff am Februar 8, 2026, https://www.unesco.org/en/en/green-digital-transformation

- Top Strategies for Data Center Liquid Cooling in 2025 – ENCOR Advisors, Zugriff am Februar 8, 2026, https://encoradvisors.com/data-center-liquid-cooling/

- Why Liquid Cooling Is the New Standard for Data Centers in 2025, Zugriff am Februar 8, 2026, https://www.datacenters.com/news/why-liquid-cooling-is-becoming-the-data-center-standard

- Sustainable by design: Next-generation datacenters consume zero water for cooling | The Microsoft Cloud Blog, Zugriff am Februar 8, 2026, https://www.microsoft.com/en-us/microsoft-cloud/blog/2024/12/09/sustainable-by-design-next-generation-datacenters-consume-zero-water-for-cooling/

- Google Sustainability: Sustainable Innovation & Technology, Zugriff am Februar 8, 2026, https://sustainability.google/

- 2025 Google Water Stewardship Project Portfolio, Zugriff am Februar 8, 2026, https://sustainability.google/reports/2025-google-water-stewardship-project-portfolio/

- Data Center Heat Reuse: Regulatory Requirements, Typical Use Cases and Optimal Planning – Polysun, Zugriff am Februar 8, 2026, https://www.velasolaris.com/en/data-center-heat-reuse/

- Infomaniak Data Centre in Geneva Integrates Trane Heat Pumps for Large-Scale Heat Recovery – Trane.eu, Zugriff am Februar 8, 2026, https://trane.eu/uk/about-trane/press-release-details.html?Id=40

- SAIHEAT Debuts at SC24 with Liquid Cooling and SMR Energy Solutions for Nextgen Data Centers | SAI.TECH Global Corporation, Zugriff am Februar 8, 2026, https://ir.saiheat.com/news-releases/news-release-details/saiheat-debuts-sc24-liquid-cooling-and-smr-energy-solutions

- SAIHEAT to announce SAIHEAT Base Plan 2029 – Nasdaq, Zugriff am Februar 8, 2026, https://www.nasdaq.com/articles/saiheat-announce-saiheat-base-plan-2029

- Using Waste Heat Generated from Data Centers:, Zugriff am Februar 8, 2026, https://npr.brightspotcdn.com/f1/1c/07c0a08f49b781f7ff4c4105bcac/catching-heat-using-waste-heat-generated-from-data-centers.pdf

- Big Tech Is Betting on Nuclear Energy to Fuel AI. But There Are Some Massive Hurdles, Zugriff am Februar 8, 2026, https://au.pcmag.com/ai/115775/big-tech-is-betting-on-nuclear-energy-to-fuel-ai-but-there-are-some-massive-hurdles

- Nuclear power for AI: inside the data center energy deals | Introl Blog, Zugriff am Februar 8, 2026, https://introl.com/blog/nuclear-power-ai-data-centers-microsoft-google-amazon-2025

- The Atomic Pivot: AI’s $50 Billion Power Move, Zugriff am Februar 8, 2026, https://www.marketbeat.com/stock-ideas/the-atomic-pivot-ais-50-billion-power-move/

- SAIHEAT Introduces HEATNUC: An Open-Source Small Modular Reactor (SMR) Solution for AI Computing Centers | SAI.TECH Global Corporation, Zugriff am Februar 8, 2026, https://ir.saiheat.com/news-releases/news-release-details/saiheat-introduces-heatnuc-open-source-small-modular-reactor-smr/

- CodeCarbon, Zugriff am Februar 8, 2026, https://codecarbon.io/

- codecarbon 2.1.0 – PyPI, Zugriff am Februar 8, 2026, https://pypi.org/project/codecarbon/2.1.0/

- Good PUE & WUE for AI Data Centers: 2026 Benchmarks – Clear Comfort, Zugriff am Februar 8, 2026, https://clearcomfort.com/pue-wue-ai-data-centers/

- Best Carbon Accounting Software 2026 | ClimatePartner, Zugriff am Februar 8, 2026, https://www.climatepartner.com/en/knowledge/blog/best-carbon-accounting-software-2026

- Transforming forest carbon tracking with AI | Stanford Report, Zugriff am Februar 8, 2026, https://news.stanford.edu/stories/2025/11/ai-satellites-benefits-forests-ecosystems-climate-change