Die technologische Landschaft im Februar 2026 markiert einen historischen Wendepunkt in der Geschichte der Informatik. Während die Jahre 2023 und 2024 von einer explorativen Begeisterung für Large Language Models (LLMs) geprägt waren, hat sich bis zum ersten Quartal 2026 eine tiefgreifende Konsolidierung vollzogen. Softwareentwicklung wird nicht mehr primär als das Schreiben von Codezeilen verstanden, sondern als die hochgradige Orchestrierung autonomer Agenten.1 Mit einem Anteil von mittlerweile an weltweit generiertem Code, der durch künstliche Intelligenz erzeugt wird, steht die Branche vor einer fundamentalen Neuausrichtung der menschlichen Rolle im Software Development Life Cycle (SDLC).2 Im Zentrum dieser Bewegung steht Google Antigravity, eine im November 2025 lancierte Plattform, die das Paradigma des „Agent-First“ Development etabliert hat.1

Die Architektur des Agentic Coding und der Aufstieg von Google Antigravity

Die Einführung von Google Antigravity hat die Erwartungen an integrierte Entwicklungsumgebungen (IDEs) radikal verschoben. Es handelt sich nicht mehr um ein reines Werkzeug zur Textmanipulation, sondern um ein autonomes Ökosystem, in dem Agenten planen, ausführen, validieren und iterieren.3 Der entscheidende Unterschied zu früheren Assistenten wie GitHub Copilot liegt in der Autonomie: Ein Agent in Antigravity ist ein eigenständiger Akteur, der komplexe Engineering-Aufgaben mit minimaler menschlicher Intervention bewältigt.3

Die Bifurkation der Benutzeroberfläche: Editor vs. Agent Manager

Ein wesentliches Merkmal von Antigravity ist die bewusste Trennung der Arbeitsbereiche in zwei primäre Fenster: den Editor und den Agent Manager.3 Diese Architektur spiegelt die psychologische Trennung zwischen detaillierter Implementierung und strategischer Planung wider. Während der Editor eine vertraute Umgebung für punktuelle manuelle Eingriffe bietet, fungiert der Agent Manager als eine Art „Mission Control“, in der Entwickler mehrere Agenten gleichzeitig beobachten und steuern können.3 Diese asynchrone Arbeitsweise erlaubt es, fünf oder mehr unabhängige Aufgaben parallel bearbeiten zu lassen – eine Effizienzsteigerung, die mit linearen Chat-Schnittstellen früherer Generationen unerreichbar war.5

Die folgende Tabelle illustriert die funktionalen Unterschiede zwischen dem Editor-Modus und dem Agent Manager innerhalb der Antigravity-Plattform:

| Funktionsbereich | Editor-Modus (Synchron) | Agent Manager (Asynchron) |

| Primäre Interaktion | Manuelles Tippen, Tab-Vervollständigung | Delegation von Aufgaben, Monitoring |

| KI-Unterstützung | Inline-Commands, Smart-Auto-Complete | Autonome Agenten-Swarms |

| Kontextfokus | Aktuelle Datei, lokale Symbole | Gesamtes Repository, Web-Ressourcen |

| Feedback-Loop | Unmittelbar (Real-time) | Artefakt-basiert (Review-orientiert) |

| Parallelisierung | Einzelner Cursor-Fokus | Multi-Agenten-Orchestrierung |

3

Artefakt-basierte Verifizierung: Die Währung des Vertrauens

Ein Kernproblem der frühen KI-Entwicklung war die sogenannte „Black Box“-Problematik: Es war schwer nachzuvollziehen, warum eine KI bestimmte Änderungen vorgenommen hatte. Antigravity adressiert dies durch ein System von Artefakten.1 Bevor ein Agent Code schreibt, generiert er eine strukturierte Aufgabenliste (Task List) und einen Implementierungsplan.3 Diese Dokumente sind keine bloßen Begleittexte, sondern die formale Grundlage für die menschliche Überprüfung. Ein Implementierungsplan enthält technische Details zur Architektur der geplanten Änderungen und muss oft vom Nutzer explizit genehmigt werden.3

Nach Abschluss einer Aufgabe liefert der Agent einen Walkthrough, der die Änderungen zusammenfasst und Verweise auf Verifizierungsdaten enthält.3 Für Frontend-Aufgaben erstellt der Agent sogar Screenshots und Videoaufzeichnungen seiner Sitzungen im integrierten Browser, sodass der Entwickler das funktionale Ergebnis prüfen kann, ohne die Anwendung selbst starten zu müssen.3 Diese Artefakte bilden eine „Kette des Vertrauens“, die sicherstellt, dass die Autonomie des Agenten nicht auf Kosten der Transparenz geht.1

Das LLM als Betriebssystem: Die Karpathy-Analogie in der Praxis

Andrej Karpathy hat das Konzept des „LLM als Betriebssystem“ popularisiert, welches im Jahr 2026 zur Standard-Referenzarchitektur für agentische Systeme geworden ist.10 In dieser Analogie wird das Sprachmodell nicht mehr als Anwendung betrachtet, sondern als die zentrale Recheneinheit (CPU) eines neuen computergestützten Stacks.10

CPU, RAM und Systemaufrufe

In der Welt von Antigravity fungiert Gemini 3 Pro als die CPU, die Logik und Planung übernimmt.10 Das Kontextfenster stellt den Arbeitsspeicher (RAM) dar – ein begrenzter, aber extrem schneller Raum für aktuelle Informationen.10 Da das Kontextfenster in modernen Modellen wie Gemini 3 bis zu eine Million Token umfasst, kann eine enorme Menge an Projektkontext gleichzeitig „geladen“ bleiben.6 Werkzeuge wie Terminalzugriff, Browser-Automatisierung oder Datenbankabfragen werden als Systemaufrufe (System Calls) behandelt, die vom LLM-Kern initiiert werden.10

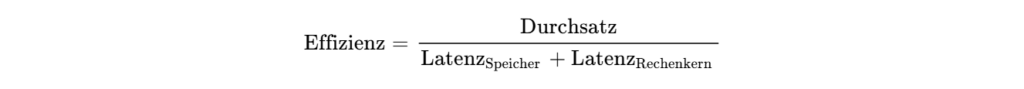

Mathematisch lässt sich die Effizienz dieser Architektur durch das Verhältnis von Rechenleistung zu Speicherzugriff beschreiben. Die „Memory Wall“ der Hardware-Physik begrenzt die Geschwindigkeit, mit der Daten die GPU-Kerne erreichen.10 Moderne Serving-Engines in Plattformen wie Antigravity nutzen daher Techniken des virtuellen Speichers, ähnlich wie klassische Betriebssysteme, um den begrenzten Grafikspeicher effizienter zu verwalten.10

Dieses Modell erklärt, warum Antigravity in der Lage ist, Repository-weite Zusammenhänge zu verstehen, während ältere Tools oft an der Grenze einzelner Dateien scheiterten.10

System 1 vs. System 2 Denken in der Programmierung

Ein weiterer entscheidender Aspekt von Karpathys Analyse ist die Anwendung der psychologischen Konzepte von Daniel Kahneman auf die KI: System 1 (schnelles, intuitives Denken) und System 2 (langsames, logisches Planen).10 Traditionelle Autovervollständigung war ein reines System-1-Werkzeug – sie lieferte sofortige, oft musterbasierte Vorschläge.3

Agentic Coding in Antigravity erzwingt hingegen ein System-2-Verhalten. Durch den „Planning Mode“ wird das Modell gezwungen, erst eine logische Kette von Schritten zu entwerfen (Chain of Thought), bevor es mit der Code-Generierung beginnt.13 Dies reduziert das Risiko von „Runaway Changes“, bei denen die KI unkontrolliert Dateien verändert, ohne die architektonischen Konsequenzen zu berücksichtigen.14 Die Einführung dieser „Denkpause“ ist der Schlüssel zur Bewältigung komplexer Refactorings und Legacy-Migrationen.14

Der Entwickler als Dirigent: Die neue Rolle im Engineering

Mit dem Aufstieg der Agenten wandelt sich die Rolle des Software-Ingenieurs von einem handwerklichen Programmierer zu einem strategischen Dirigenten oder Orchestrator.1 Es wird prognostiziert, dass bis Ende 2026 etwa der Ingenieure ihre Hauptaufgabe in der Orchestrierung von KI-Prozessen sehen werden.2

Orchestrierung von Multi-Agenten-Systemen

In einem modernen Workflow dirigiert der Mensch spezialisierte Agenten, die jeweils unterschiedliche Fähigkeiten besitzen. Ein Agent kümmert sich um die Security-Analyse, ein anderer um das Schreiben von Unit-Tests, während ein dritter das UI-Framework aktualisiert.17 Antigravity unterstützt dies durch die Möglichkeit, Agenten mit spezifischen Berechtigungsumfängen (Scopes) zu versehen, wie etwa „nur Editor“, „nur Terminal“ oder „nur Browser“.4

Die Koordination dieser Agenten erfolgt über standardisierte Protokolle. Neben dem Model Context Protocol (MCP) von Anthropic haben sich Google’s A2A und IBM’s ACP als Industriestandards etabliert.2 Diese Protokolle ermöglichen es Agenten, nahtlos auf über 10.000 verschiedene Tools und Server zuzugreifen, was die funktionale Reichweite der KI exponentiell vergrößert.2

Die folgende Tabelle gibt einen Überblick über die Kernkompetenzen eines „Orchestrators“ im Jahr 2026 im Vergleich zum klassischen Entwicklerprofil:

| Kompetenz | Klassischer Entwickler (bis 2024) | Orchestrator / Dirigent (ab 2026) |

| Primärwerkzeug | Texteditor, Debugger | Agent-First IDE, Mission Control |

| Haupttätigkeit | Syntax schreiben, Logik implementieren | Problem-Dekomposition, Verifizierung |

| Wissensfokus | Programmiersprachen, Frameworks | Systemarchitektur, Context Engineering |

| Problemlösung | Manuelles Debugging | Agentische Ursachenanalyse, Test-Loops |

| Qualitätssicherung | Code-Reviews durch Menschen | Automatisierte Artefakt-Validierung |

2

Context Engineering als Nachfolger des Prompt Engineering

Während „Prompt Engineering“ in den Jahren 2023 und 2024 noch als die wichtigste Fähigkeit galt, ist es im Februar 2026 durch „Context Engineering“ ersetzt worden.12 Es geht nicht mehr nur um den initialen Befehl, sondern um das kontinuierliche Management der Informationen, auf die ein Agent während seiner gesamten Reise Zugriff hat.12 Ein Orchestrator muss entscheiden, welche Teile der Dokumentation, welche Legacy-Module und welche externen APIs in das limitierte „RAM“ des Kontextfensters geladen werden.12

Vier Säulen definieren diesen Prozess:

- Write Context: Speichern von Langzeit-Erinnerungen und Präferenzen in Wissensdatenbanken.12

- Select Context: Gezieltes Abrufen relevanter Informationen (RAG) zum exakten Zeitpunkt der Ausführung.12

- Compress Context: Zusammenfassung langer Konversationen, um nur die essenziellen Informationen zu behalten.12

- Isolate Context: Aufteilung komplexer Probleme auf mehrere Agenten, um gegenseitige „Ablenkung“ im Kontextfenster zu vermeiden.12

Vibe Coding: Die Demokratisierung der Softwareerstellung

Ein Begriff, der im Jahr 2025 zum „Wort des Jahres“ gekürt wurde und die Praxis im Jahr 2026 dominiert, ist „Vibe Coding“.2 Dieser Paradigmenwechsel beschreibt eine Form der Entwicklung, bei der der Mensch lediglich die Vision, die Ästhetik oder den „Vibe“ eines Produkts beschreibt, während die KI die technische Realisierung übernimmt.2

Von der Vision zum Produkt

Vibe Coding ermöglicht es selbst Nicht-IT-Teams, komplexe Anwendungen zu bauen. Statistiken zeigen, dass bereits der Nutzer von KI-Coding-Tools aus Fachabteilungen außerhalb der IT kommen.2 Plattformen wie Emergent oder Antigravity erlauben es, Absichten in natürlicher Sprache zu formulieren: „Ich möchte eine Dashboard-App für unser Sales-Team, die sich wie eine Mischung aus Salesforce und einem modernen FinTech-Tool anfühlt“.2 Die KI generiert daraufhin die Architektur, die Logik und die Datenmodelle als ein konsistentes Gesamtsystem.4

Dieser Ansatz ist jedoch nicht ohne Kritik. Während er die Barrieren für die Softwareerstellung senkt, besteht die Gefahr, dass die Grenze zwischen einem schnellen Prototyp und einer robusten Produktionsanwendung verschwimmt.21 Matt Welsh argumentiert, dass wir uns auf eine Zukunft zubewegen, in der Softwaremodelle nicht mehr nur als Blaupausen dienen, sondern „post-hoc“ aus dem generierten Code zurückgewonnen werden müssen, um die Wartbarkeit und Sicherheit zu gewährleisten.21

Die wirtschaftlichen Auswirkungen: Tiny Teams und Effizienzsprünge

Die ökonomischen Folgen des Agentic Coding sind im Februar 2026 unübersehbar. Sogenannte „Tiny Teams“ – bestehend aus nur ein oder zwei Experten mit mächtigen KI-Tools – können heute Leistungen erbringen, für die früher ganze Entwicklungsabteilungen nötig waren.2 Daten aus dem Ende des Jahres 2025 deuten darauf hin, dass agentenbasierte Workflows komplexe Refactorings um bis zu beschleunigen können.14 Gleichzeitig führt dies zu einer Verschiebung im Arbeitsmarkt: Während die Nachfrage nach reinen „Task-Executoren“ sinkt, steigt der Bedarf an strategischen Denkern, die in der Lage sind, komplexe Geschäftsprobleme in agentische Workflows zu übersetzen.20

Risiken: Halluzinationen, Sicherheitslücken und „AI Slop“

Trotz der Euphorie ist das Jahr 2026 auch geprägt von einer wachsenden Skepsis gegenüber der Qualität KI-generierter Software. Das Problem des „AI Slop“ – minderwertiger, aufgeblähter Code, der zwar oberflächlich funktioniert, aber fundamentale Mängel aufweist – ist zu einer ernsthaften Bedrohung für die langfristige Stabilität von Enterprise-Systemen geworden.22

Die Sicherheitsparadoxie

Studien zur Sicherheit von KI-generiertem Code liefern ernüchternde Ergebnisse. Benchmark-Tests wie BaxBench zeigen, dass selbst Spitzenmodelle wie Claude Opus 4.5 nur in der Fälle korrekten und sicheren Code liefern, wenn keine expliziten Sicherheitsvorgaben gemacht werden.15 Selbst bei aktivem Sicherheitstraining steigt dieser Wert nur auf

, was bedeutet, dass fast jede dritte KI-generierte Komponente potenzielle Schwachstellen enthält.15

Besonders alarmierend ist die Risikoverteilung nach Programmiersprachen und Schwachstellentypen:

| Risikofaktor | Statistik / Auswirkung | Kontext |

| Sprachspezifisches Risiko (Java) | 72% Sicherheits-Fehlerrate | Komplexität und Boilerplate erhöhen Fehleranfälligkeit.24 |

| Cross-Site Scripting (XSS) | 86% Fehlerrate | KI versäumt oft die Sanitisierung von Inputs.24 |

| Hardcoded Secrets | In >35% der Fälle vorhanden | API-Keys werden oft direkt in den Code geschrieben.24 |

| OWASP Top 10 Abdeckung | 45% der KI-Codes enthalten Lücken | Grundlegende Sicherheitsmuster werden ignoriert.24 |

| Dependency Overuse | 2-5 zusätzliche Abhängigkeiten | KI neigt dazu, für einfache Probleme externe Pakete zu laden.24 |

15

Ein weiteres Phänomen ist der Einfluss von Modell-Biases auf die Code-Sicherheit. Forscher entdeckten beispielsweise, dass Modelle bei der Abfrage von politisch sensiblen Themen Code generieren, der eine um höhere Dichte an Schwachstellen aufweist als bei neutralen Prompts.24 Dies unterstreicht die Notwendigkeit, KI-generierten Code als „grundsätzlich nicht vertrauenswürdig“ zu behandeln.15

Halluzinationen und architektonische Drift

Halluzinationen bleiben ein persistentes Problem. Im Kontext von Antigravity äußern sich diese oft als „Instruction Drift“, bei dem der Agent im Verlauf einer langen Sitzung seine ursprünglichen Ziele aus den Augen verliert.12 Besonders kritisch ist dies bei Legacy-Systemen: Während Agenten hervorragend darin sind, neue Strukturen (Scaffolding) aufzubauen, stoßen sie bei der Aktualisierung komplexer, über Jahrzehnte gewachsener Logik an ihre Grenzen.16 Ohne menschliche Aufsicht können Halluzinationen den Fortschritt „wegfressen“, indem funktionierender Code durch fehlerhafte, aber plausibel erscheinende KI-Logik ersetzt wird.12

Die Antwort der Industrie: Google Conductor und automatisierte Verifizierung

Um den Risiken von Halluzinationen und Sicherheitslücken zu begegnen, hat Google im Februar 2026 Erweiterungen für seine agentischen Plattformen vorgestellt, allen voran Google Conductor AI.25

Das Verify-Paradigma

Conductor führt einen dedizierten „Verify“-Schritt in den SDLC ein. Sobald ein Programmier-Agent seine Aufgabe abgeschlossen hat, generiert Conductor einen detaillierten Compliance-Bericht.25 Dieses System prüft nicht nur, ob der Code läuft, sondern ob er den zuvor definierten Anforderungen in plan.md und spec.md entspricht.25 Conductor agiert hierbei als digitaler Peer-Reviewer, der tiefe statische und logische Analysen durchführt, um Race Conditions oder potenzielle Null-Pointer-Risiken zu finden.25

Die Sicherheitsfunktionen von Conductor umfassen:

- PII-Scans: Identifizierung von Leaks personenbezogener Daten vor dem Commit.25

- Geheimnis-Erkennung: Automatisches Flaggen von hartkodierten API-Keys oder Zugangsdaten.25

- Schweregrad-Kategorisierung: Einstufung von Sicherheitsfunden in High, Medium und Low, um Entwicklern eine Priorisierung zu ermöglichen.26

- Actionable Intelligence: Bereitstellung exakter Dateipfade und Anweisungen für den Agenten, um erkannte Fehler sofort zu beheben.26

Integrierte Sicherheitstools im Jahr 2026

Neben Google setzen auch andere Anbieter auf tief integrierte Sicherheitslösungen. Snyk Agent Fix generiert und validiert Sicherheitsfixes in Echtzeit direkt in der IDE, während Checkmarx One und GitLab Duo Schwachstellenscans in die agentischen Workflows einbetten.15 Die Industrie bewegt sich weg von punktuellen Scans nach der Entwicklung hin zu einer „Security-First“ Architektur, bei der Sicherheitsschranken (Guardrails) bereits während der Generierung aktiv sind.18

Expertenmeinungen: Welsh, Orosz und die Zukunft der Arbeit

Die Debatte über die langfristigen Folgen dieser Entwicklung wird von prominenten Stimmen der Branche angeführt. Matt Welsh vertritt die radikale These vom „Ende der Programmierung“.27 Er argumentiert, dass die Kosten und die Komplexität der Softwareentwicklung durch LLMs so weit sinken werden, dass natürliche Sprachschnittstellen die konventionelle Programmierung fast vollständig ablösen.28 Das Berufsfeld werde sich weniger wie Ingenieurwesen und mehr wie Pädagogik anfühlen: Es gehe darum, die Maschine bestmöglich zu „erziehen“.21

Gergely Orosz, Autor von „The Pragmatic Engineer“, beobachtet hingegen eine differenziertere Entwicklung. Er stellt fest, dass das „Schreiben von Code per Hand“ zwar in vielen Bereichen aussterbe, aber die Bedeutung von erfahrenen Ingenieuren, die Kontrolle über den SDLC behalten, paradoxerweise zunehme.30 Orosz weist darauf hin, dass die wachsende Code-Komplexität, die durch Agenten verursacht wird, neue Werkzeuge erfordert, die den Menschen im Zentrum der Entscheidungsgewalt halten.30 Er sieht einen Trend zu „Staff+ Ingenieuren“ und Managern, die KI massiv nutzen, um wie ganze Teams zu agieren, ohne die architektonische Übersicht zu verlieren.32

Die folgende Übersicht fasst die gegensätzlichen Positionen zusammen:

| Perspektive | Kernthese | Fokus |

| Matt Welsh | Ende der Programmierung | KI schreibt |

| Gergely Orosz | Dramatischer Wandel der Rolle | Orchestrierung statt Syntax; Fokus auf Architektur. |

| Andrej Karpathy | LLM als Betriebssystem | KI als Kern-CPU; neue Rechenparadigmen. |

| Gartner | Demokratisierung der Entwicklung | 40% der Enterprise-Apps mit Agenten bis Ende 2026. |

2

Fazit: Die Synthese von Mensch und Maschine im Jahr 2026

Der Rückblick auf die Entwicklungen bis Februar 2026 zeigt, dass die anfängliche Angst vor der Ersetzung des Menschen einer differenzierteren Realität gewichen ist. Agentic Coding, wie es in Google Antigravity praktiziert wird, ist kein Ersatz für menschliche Intelligenz, sondern deren Kraftverstärker.20 Die Rolle des Entwicklers hat sich unumkehrbar gewandelt: Wer früher Syntaxprobleme löste, entwirft heute agentische Workflows und validiert deren Output durch ein System von Artefakten und automatisierten Reviews.2

Die Herausforderungen – insbesondere die Sicherheit von KI-generiertem Code und das Risiko von „AI Slop“ – erfordern eine neue Form der handwerklichen Sorgfalt.15 Vertrauen wird im Jahr 2026 nicht mehr durch das Lesen jeder Codezeile gewonnen, sondern durch die Überprüfung der Logikketten und der generierten Artefakte.1 Der Erfolg in dieser Ära gehört jenen, die die „Dirigentenrolle“ annehmen und lernen, die mächtigen Agenten-Swarms sicher durch die komplexen Anforderungen moderner Softwarearchitektur zu steuern.19 Wir befinden uns nicht am Ende der Softwareentwicklung, sondern am Beginn einer dritten goldenen Ära, in der die einzige Grenze die menschliche Vorstellungskraft ist.6

Natürlich mache ich als Software Architekt mit den Trends mit. Meine Erfahrungen sind durchmischt von schnellen, guten Erfolgen und häufigen Wartezeiten, die ich nur abkürzen kann indem ich selbst die Code-Fehler gleich sehe und fixe. Ob es Klammern oder falsche Typbezeichnungen sind, oder manchmal Teile vom Code doppelt eingefügt werden oder Blöcke fehlen: Bei diesen Problemen kann ich zwar die KI fragen, aber Credit-Schonend und Zeit-Schonend ist das nicht, darauf zu warten.

Spannend finde ich aber, wie schnell zum Beispiel mathematische Grundlagen oder Wissen, das ich erst mühsam mir erarbeiten müsste, mit einfachen und klaren Prompts generiert und zugleich mir das generierte beschrieben wird. Gebe ich noch Hinweise dazu, wie der Code sicher sein soll oder ob es nach Clean Coding Principles gebaut werden soll, dann wird das auch so umgesetzt. In einem Tempo wo ich mit dem Mitschauen überfordert bin und die Nacharbeit bei mir, das testen und überblicken des Ergebnisses, deutlich länger dauert als die reine Code Generierung.

Ich habe mit ca. 10 Jahren (also vor sehr langer Zeit) zum Programmieren angefangen, Und bin sowas von fastziniert was heute nun möglich ist und sehr gespannt, wo meine und die Reise der Welt so hingeht.

Erkennbar ist für mich nach der Demokratisierung der Kunst eine echte demokratisierung der Technik auf einem Level, wo jeder, der möchte, einsteigen und viel lernen kann indem er / sie die eigenen Ideen gleich umsetzen versucht.

Ich kann es nur jeden „Idea Guy“ raten, es nun selbst umsetzen zu versuchen.

Mit inspirierenden Grüßen,

Euer Krischan

Referenzen:

- Build with Google Antigravity, our new agentic development platform …, Zugriff am Februar 16, 2026, https://developers.googleblog.com/build-with-google-antigravity-our-new-agentic-development-platform/

- AI Agents in Software Development (2026): Practical Guide – Senorit, Zugriff am Februar 16, 2026, https://senorit.de/en/blog/ai-agents-software-development-2026

- Getting Started with Google Antigravity, Zugriff am Februar 16, 2026, https://codelabs.developers.google.com/getting-started-google-antigravity

- 6 Best Google Antigravity Alternatives and Competitors in 2026 – Emergent, Zugriff am Februar 16, 2026, https://emergent.sh/learn/best-google-antigravity-alternatives-and-competitors

- Google Antigravity is an ‚agent-first‘ coding tool – Altamira, Zugriff am Februar 16, 2026, https://www.altamira.ai/blog/antigravity-is-agent-first-coding-tool/

- Antigravity + Claude Code + Gemini 3 Pro = Incredible : r/vibecoding – Reddit, Zugriff am Februar 16, 2026, https://www.reddit.com/r/vibecoding/comments/1pihn0c/antigravity_claude_code_gemini_3_pro_incredible/

- Implementation Plan – Google Antigravity Documentation, Zugriff am Februar 16, 2026, https://antigravity.google/docs/implementation-plan

- Walkthrough – Google Antigravity Documentation, Zugriff am Februar 16, 2026, https://antigravity.google/docs/walkthrough

- Google Antigravity Blog: introducing-google-antigravity, Zugriff am Februar 16, 2026, https://antigravity.google/blog/introducing-google-antigravity

- Architecting the Cognitive Operating System of 2026 | Rabbit hole, Zugriff am Februar 16, 2026, https://www.holeoftherabbit.com/2026/01/15/architecting-the-cognitive-operating-system-of-2026/

- Software 3.0 Blueprint: From Vibe Coding to Verified Intelligence Swarms | by Takafumi Endo | Medium, Zugriff am Februar 16, 2026, https://medium.com/@takafumi.endo/software-3-0-blueprint-from-vibe-coding-to-verified-intelligence-swarms-23b4537f12fa

- The Art and Science of Context Engineering for AI Agents | by Arvind kumar Vartiya, Zugriff am Februar 16, 2026, https://medium.com/@arvindkrvartiya/the-art-and-science-of-context-engineering-for-ai-agents-0647ed4f55b5

- Anyone got tips / tricks / hacks to actually enjoy Anti-Gravity? I’m struggling – Reddit, Zugriff am Februar 16, 2026, https://www.reddit.com/r/google_antigravity/comments/1ptnd90/anyone_got_tips_tricks_hacks_to_actually_enjoy/

- Antigravity vs. Windsurf – What’s the Best Agentic IDE in 2026 …, Zugriff am Februar 16, 2026, https://blog.getbind.co/antigravity-vs-windsurf-whats-the-best-agentic-ide-in-2026/

- As More Coders Adopt AI Agents, Security Pitfalls Lurk in 2026 – Dark Reading, Zugriff am Februar 16, 2026, https://www.darkreading.com/application-security/coders-adopt-ai-agents-security-pitfalls-lurk-2026

- Google Antigravity vs Claude Code: Agent-First Development vs Terminal-First Control, Zugriff am Februar 16, 2026, https://www.augmentcode.com/tools/google-antigravity-vs-claude-code

- 2026 Agentic Coding Trends Report | Anthropic, Zugriff am Februar 16, 2026, https://resources.anthropic.com/hubfs/2026%20Agentic%20Coding%20Trends%20Report.pdf?hsLang=en

- 2026 Agentic Coding Trends – Implementation Guide (Technical) – Hugging Face, Zugriff am Februar 16, 2026, https://huggingface.co/blog/Svngoku/agentic-coding-trends-2026

- Future-Proofing Your Career: The Best IT Skills Required in 2026 – LTSU, Zugriff am Februar 16, 2026, https://ltsu.ac.in/blog/future-proofing-your-career-the-best-it-skills-required-in-2026/

- The 2026 Professional Growth & AI Adaptation Roadmap – Scribd, Zugriff am Februar 16, 2026, https://www.scribd.com/document/982821972/The-2026-Professional-Growth

- The End of Programming – ResearchGate, Zugriff am Februar 16, 2026, https://www.researchgate.net/publication/366448923_The_End_of_Programming

- Google Antigravity Review: Is it a $20 AI Coding Paperweight? – Vertu, Zugriff am Februar 16, 2026, https://vertu.com/lifestyle/the-google-antigravity-controversy-why-users-call-the-20-ai-ide-a-paperweight-in-2026/

- 2026 Trends + 90-Day Skill Plan – Sweta Singh – Medium, Zugriff am Februar 16, 2026, https://medium.com/@sweta.singh2025/2026-trends-90-day-skill-plan-cc0e69ab25e7

- The State of AI Code Security in 2026: What You Need to Know Right Now : r/vibecoding, Zugriff am Februar 16, 2026, https://www.reddit.com/r/vibecoding/comments/1qa1pye/the_state_of_ai_code_security_in_2026_what_you/

- Google adds automated code reviews to Conductor AI | InfoWorld, Zugriff am Februar 16, 2026, https://www.infoworld.com/article/4132242/google-adds-automated-code-reviews-to-conductor-ai.html

- Conductor Update: Introducing Automated Reviews – Google …, Zugriff am Februar 16, 2026, https://developers.googleblog.com/conductor-update-introducing-automated-reviews/

- The Rise and Fall(?) of Coding Bootcamps – Bestcolleges.com, Zugriff am Februar 16, 2026, https://www.bestcolleges.com/news/rise-and-fall-of-coding-bootcamps/

- Large Language Models and the End of Programming | PDF – Slideshare, Zugriff am Februar 16, 2026, https://www.slideshare.net/slideshow/large-language-models-and-the-end-of-programming/269437462

- The Top 10 Blog Posts of 2023 – Software Engineering Institute, Zugriff am Februar 16, 2026, https://www.sei.cmu.edu/blog/the-top-10-blog-posts-of-2023/

- The Pragmatic Engineer – Apple Podcasts, Zugriff am Februar 16, 2026, https://podcasts.apple.com/us/podcast/the-pragmatic-engineer/id1769051199

- The Pragmatic Engineer podcast | Listen online for free – uk.radio.net, Zugriff am Februar 16, 2026, https://uk.radio.net/podcast/the-pragmatic-engineer-podcast

- The Pragmatic Engineer | Gergely Orosz | Substack – /dev/All, Zugriff am Februar 16, 2026, https://www.devall.com.br/source/6182